La protection des travailleurs dans le cadre de la loi européenne sur l’IA

L’Europe : la seule région à avoir réglementé l’IA

Cette note d'information fournit aux représentants syndicaux les outils nécessaires pour dénoncer et lutter contre l'utilisation abusive de l'IA au travail.

L’Europe : la seule région à avoir réglementé l’IA

Cette note d’information fournit aux représentants syndicaux les outils nécessaires pour dénoncer et lutter contre l’utilisation abusive de l’IA au travail.

La loi européenne sur l’IA (règlement 2024/1689) crée le premier cadre au monde pour gérer intégralement l’intelligence artificielle. Elle apporte aussi des protections strictes pour les travailleurs soumis à la gestion algorithmique. Une fiche de référence claire et concise est précieuse pour les représentants syndicaux. Elle leur donne les connaissances nécessaires afin d’anticiper et de contester les effets du management par l’algorithme (MA). Les systèmes d’IA influencent de plus en plus l’embauche, l’évaluation et la gestion quotidiennes. Des conseils accessibles leur permettent donc d’assurer l’équité, la transparence et la dignité au travail.

La loi européenne sur l’IA est l’instrument principal pour réglementer le management par l’algorithme. Le règlement général sur la protection des données (RGPD) reste cependant fondamental pour protéger les travailleurs, surtout quand des décisions automatisées sont prises. Selon l’article 22 du RGPD, chacun a le droit de ne pas être soumis à une décision fondée uniquement sur un traitement automatisé qui l’affecte fortement. Cela couvre les embauches, promotions ou licenciements décidés par des outils d’IA. Ces deux textes forment un régime complémentaire : la loi sur l’IA régit la conception et l’usage des IA à haut risque, tandis que le RGPD protège les droits procéduraux, la transparence et les voies de recours des travailleurs concernés.

La loi européenne sur l’IA entrera en vigueur par étapes. Il est essentiel d’intégrer cette chronologie afin d’anticiper les obligations des employeurs et garantir une protection rapide des travailleurs.

Février 2025 — Application des interdictions et des exigences en matière de connaissances sur l’IA

Les pratiques interdites en matière d’IA, telles que la reconnaissance des émotions sur le lieu de travail et l’IA manipulatrice, deviennent juridiquement contraignantes. En outre, les exigences en matière de connaissances en IA entrent en vigueur.

Août 2025 — Application des obligations relatives aux modèles d’IA à usage général

Les exigences relatives aux modèles d’IA à usage général, y compris la documentation et les contrôles des risques, entrent en vigueur.

Août 2026 — Application de la plupart des obligations relatives aux risques élevés, y compris l’IA dans le domaine de l’emploi

Cette étape est décisive pour les travailleurs. Toutes les obligations sur les systèmes à haut risque deviennent applicables, y compris pour les outils de recrutement, les algorithmes d’évaluation, les systèmes d’attribution des tâches et l’IA pour les licenciements. Cela inclut le respect des articles 9 à 15 portant sur la gestion des risques, la gouvernance des données, la transparence, la supervision humaine, la tenue de registres, l’exactitude et la robustesse.

Août 2027 — Les obligations restantes s’appliquent

Les dispositions finales de la loi entrent en vigueur, complétant ainsi le cadre réglementaire.

Dès août 2026, les représentants syndicaux devront demander aux employeurs des documents précis : rapports d’évaluation des risques, inventaires des données, registres de contrôle humain. Identifier et demander ces pièces facilite les négociations. Cela aide aussi à bâtir des dossiers fondés sur des preuves pour responsabiliser les employeurs et négocier de meilleures protections.

Pour aider à traduire cette exigence en mesures concrètes, les représentants syndicaux peuvent utiliser l’évaluation des risques comme occasion de dialogue. Par exemple, ils peuvent demander : «Quelles caractéristiques protégées ont été testées pour détecter les préjugés ? Comment les risques de traitement injuste lors du recrutement et de l’évaluation ont-ils été identifiés ? Quelles mesures garantissent la qualité et la pertinence des données ? Qui a participé à l’évaluation ? Les travailleurs ont-ils été consultés ? Existe-t-il des procédures claires si un travailleur souhaite contester une décision prise par l’IA ?». En posant ces questions, les représentants rendent la gestion des risques un sujet concret et constructif de dialogue avec les employeurs.

Dans un cas, par exemple, les données consignées dans les journaux informatiques (logs) ont permis d’établir clairement qu’une décision de licenciement automatisée avait été déclenchée par une erreur de saisie, ce qui a permis à un travailleur de contester et, finalement, d’annuler son licenciement. (Un tribunal espagnol annule un licenciement fondé sur une lettre de licenciement générée par l’IA, 2024) Des exemples concrets comme celui-ci montrent pourquoi l’accès rapide aux journaux, en vertu de l’article 12, est essentiel et peut inciter les représentants à demander ces preuves dans le cadre de leur surveillance régulière.

Définition d’une catégorie d’emploi à haut risque

La loi européenne sur l’IA définit comme à haut risque les systèmes d’IA utilisés pour le recrutement, la sélection des candidats, le contrôle des performances ou les décisions ayant une incidence sur les conditions d’emploi. Cette classification garantit que les employeurs ne peuvent pas déployer de tels systèmes sans satisfaire à des obligations légales strictes visant à protéger les droits fondamentaux et à prévenir les décisions discriminatoires ou opaques. Par exemple, les systèmes d’IA liés à l’emploi, tels que ceux utilisés pour le recrutement, l’évaluation, l’attribution des tâches, la promotion ou le licenciement, sont explicitement classés comme à haut risque en vertu de l’article 6, paragraphe 2, et de l’annexe III, catégorie 4, ce qui déclenche les mesures de protection les plus strictes prévues par la loi.

Mesures de protection fondamentales (articles 9 à 15)

Les employeurs doivent évaluer, documenter et atténuer les risques tout au long du cycle de vie du système d’IA afin de réduire les préjudices tels que les préjugés, les notes discriminatoires et les licenciements injustifiés.

La loi exige des ensembles de données de haute qualité, représentatifs et impartiaux pour l’IA appliquée à l’emploi, afin d’atténuer les risques de discrimination dans le recrutement ou l’évaluation.

Une documentation complète du système favorise la responsabilité et facilite les consultations avec les travailleurs. Elle permet aussi d’enquêter sur les décisions algorithmiques injustes.

Les systèmes d’IA doivent conserver des journaux détaillés, permettant aux travailleurs et aux régulateurs d’auditer les décisions, de contester les résultats et d’identifier les problèmes systémiques.

Les travailleurs ont une meilleure visibilité sur le fonctionnement des systèmes d’IA, les données qu’ils utilisent et la manière dont les décisions automatisées sont prises. Cela permet de remédier aux règles de décision cachées qui, sans cela, maintiendraient les travailleurs dans l’ignorance quant à l’impact de l’IA sur leur situation.

Les employeurs doivent garantir une participation humaine significative aux décisions prises par l’IA. Les licenciements, évaluations ou mesures disciplinaires entièrement automatisés sont interdits, afin de préserver la dignité des travailleurs et le respect des procédures régulières.

Les IA à haut risque doivent être précises et résilientes, afin de réduire les évaluations erronées, les classifications incorrectes et d’autres conséquences néfastes pour les travailleurs.

La loi interdit certaines pratiques jugées risques inacceptables pour les droits fondamentaux, la sécurité et l’intérêt public. Il s’agit notamment :

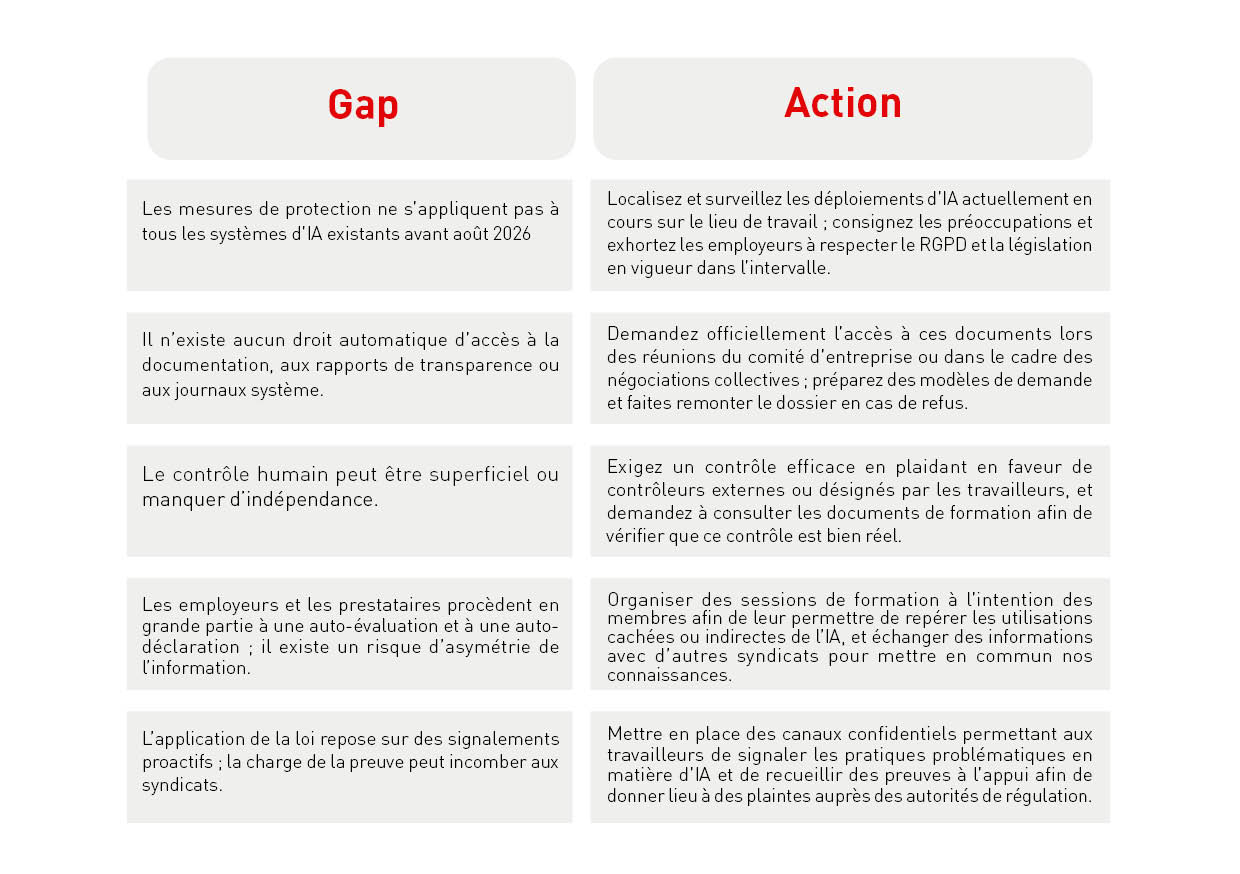

Malgré les promesses solides protections de la loi européenne sur l’IA, d’importantes lacunes subsistent. La loi offre aux syndicats un nouveau levier pour lutter contre le management par l’algorithme, mais ses garanties ne sont ni automatiques ni exhaustives, et de nombreuses protections ne prendront effet que dans un avenir proche. Cette tension entre promesse et réalité plante le décor : les syndicats acquièrent des outils juridiques puissants, mais la charge de garantir un véritable changement sur le lieu de travail incombe toujours aux représentants. L’efficacité de l’application de la loi dépendra de la manière dont les syndicats utiliseront ces dispositions et de la manière dont les employeurs s’y conformeront. Afin d’aider les membres des syndicats à se sentir à la fois avertis et responsabilisés, il est important d’associer chaque limitation de la loi à une mesure d’organisation pratique et immédiate.

Le tableau ci-dessous présente les principales lacunes et les mesures correspondantes que les représentants peuvent prendre dès maintenant :

Inspired by The Why Not Lab, founded by Dr Christina Colclough, advisor to UNI Global Union on digitalisation and algorithmic management. https://www.thewhynotlab.com/services/toolkit

Cette approche permet aux représentants syndicaux de réagir de manière proactive aux limites de la loi et de transformer les lacunes législatives en champs d’action immédiats pour l’organisation.

Les représentants peuvent s’appuyer sur les obligations strictes de la loi pour les emplois à haut risque liés à l’IA. Cependant, ils doivent reconnaître que la plupart des dispositions relatives à l’IA sur le lieu de travail ne s’appliqueront qu’à partir d’août 2026, laissant de nombreux systèmes actuels non réglementés en pratique jusqu’à cette date. Pendant cette période transitoire, les employeurs peuvent adopter ou développer des systèmes d’IA que les syndicats ne peuvent contester qu’indirectement, au moyen du RGPD ou des lois existantes, telles que la Directive sur les plateformes.

Bien que la loi exige la documentation, la transparence et la consignation, elle n’accorde pas aux travailleurs ni aux syndicats un accès automatique à ces documents. La demande d’accès deviendra probablement un sujet de négociation ou de conflit, en particulier au sein des institutions où les employeurs invoquent la confidentialité ou la protection de la propriété intellectuelle. Si les obligations de transparence prévues par la loi s’appliquent aux déployeurs, l’étendue des informations que les travailleurs recevront, dans la pratique, reste floue.

Pour ancrer concrètement ces défis dans les négociations, les représentants syndicaux peuvent proposer des clauses spécifiques, telles que la création d’un comité mixte chargé d’examiner les algorithmes, l’obligation d’informer les syndicats à l’avance de tout déploiement ou de toute mise à jour majeure de systèmes d’IA à haut risque, ou l’octroi d’un droit permanent aux experts désignés par les syndicats d’auditer la documentation technique et les fichiers journaux. D’autres clauses pourraient inclure l’obligation pour l’employeur et le syndicat de rédiger conjointement des rapports de transparence ou d’assurer une surveillance conjointe des biais algorithmiques. En intégrant ces leviers dans les accords du comité d’entreprise ou dans les négociations collectives, les représentants peuvent aller au-delà des droits théoriques pour obtenir un accès pratique et exécutoire à l’information.

Les exigences en matière de contrôle humain peuvent sembler rassurantes ; cependant, le terme « contrôle humain significatif » est défini de manière vague, ce qui permet un contrôle symbolique ou une simple validation des décisions algorithmiques. La loi ne garantit pas que le contrôleur humain sera indépendant, habilité ou formé pour remettre en question les résultats de l’IA, malgré l’application préalable d’obligations générales relatives aux connaissances de l’IA. Par conséquent, la clause « human-in-the-loop » risque de rester procédurale plutôt que substantielle.

Pour remédier à cela, les représentants syndicaux peuvent aller au-delà de la simple confirmation de l’existence d’un contrôle humain et s’intéresser plutôt à sa qualité. Une simple liste de contrôle peut aider à évaluer si la supervision est vraiment significative : le contrôleur est-il indépendant du fournisseur du système ou est-il soumis à des conflits d’intérêts ? Le contrôleur humain a-t-il réellement le pouvoir de contester ou d’annuler les décisions de l’IA ? Le contrôleur a-t-il reçu une formation adéquate pour comprendre les résultats et les risques de l’IA ? L’utilisation de tels critères, inspirés des cadres d’audit éthique, peut aider les représentants à promouvoir une supervision substantielle et efficace plutôt qu’une simple vérification administrative.

De plus, le cadre fondé sur les risques et la conformité prévu par la loi impose aux employeurs et aux fournisseurs d’IA une responsabilité importante en matière d’auto-évaluation, d’auto-documentation et d’auto-surveillance. Les syndicats doivent anticiper les asymétries d’information et de pouvoir, en particulier dans les lieux de travail complexes où la gestion algorithmique est intégrée à des systèmes propriétaires. Même l’interdiction de la reconnaissance des émotions et d’autres pratiques manipulatrices de l’IA, bien que juridiquement applicable aujourd’hui, nécessitera une surveillance et un signalement actifs de la part des travailleurs, la charge de la preuve pouvant incomber aux syndicats.

Pour alléger ce fardeau et favoriser une culture de vigilance participative, les syndicats sont encouragés à développer les compétences collectives de leurs membres. Une mesure concrète consiste à créer conjointement des listes de contrôle simples ou des outils de repérage qui aident à identifier les systèmes d’IA sur le lieu de travail, les pratiques douteuses ou les violations potentielles. En impliquant les travailleurs dans la conception de ces outils communs, les syndicats peuvent renforcer la confiance de leurs membres pour détecter, documenter et soulever ensemble leurs préoccupations. Cette approche collaborative transforme la surveillance passive en un apprentissage communautaire actif, faisant des travailleurs des partenaires clés pour garantir la conformité et faire progresser la protection des travailleurs.

Enfin, bien que l’article 22 du RGPD prévoie un droit essentiel de contester les décisions entièrement automatisées, ce droit est limité, difficilement exercé et souvent mal appliqué en pratique. De nombreux employeurs affirment que les décisions influencées par l’IA, mais qui ne sont pas formellement « uniquement automatisées », ne relèvent pas des dispositions du RGPD. Les décisions prises à l’aide de l’IA dans le cadre du recrutement ou de l’évaluation des performances brouillent souvent cette distinction, ce qui complique la capacité des travailleurs à démontrer quand un système d’IA a été déterminant. (Capasso et al., 2025) Pour ces raisons, la loi européenne sur l’IA n’est pas une panacée. Elle fournit des outils importants, mais leur efficacité dépend de la capacité des syndicats à :

En résumé, la loi européenne sur l’IA pose de nouveaux défis/opportunités/détours ; cependant, les syndicats devront faire preuve de persévérance, d’expertise et exercer une pression collective pour concrétiser ces avantages. Les réglementations fournissent des outils utiles, mais ne garantissent pas les résultats. Les représentants syndicaux restent essentiels pour traduire les obligations légales en une protection efficace des travailleurs.

Emmanuel Wietzel est un formateur expérimenté auprès des acteurs syndicaux européens (entre autres la Cgt, FSESP, ETUI, USF, FERPA, Eurocadres). Il aide les syndicats et leurs dirigeants à analyser les enjeux européens et à élaborer des stratégies collectives pour faire face aux transformations du travail. Il s’intéresse actuellement à l’impact de l’IA sur le monde du travail et au rôle renouvelé du syndicalisme. Alliant engagement pratique et expertise analytique, il contribue activement aux débats sur l’avenir du travail et sur la négociation collective en Europe.